2024年诺贝尔物理学奖授予神经网络,大出业界预料

新闻链接:诺贝尔基金会2024年物理学奖官方发布

新闻链接:诺贝尔基金会2024年物理奖背景扩展介绍

新闻链接:芯语2024年10月9日《2024年诺贝尔物理奖官方解读:他们用物理解码信息》

斯德哥尔摩时间10月8日,2024年诺贝尔物理学奖揭晓。美国科学家约翰·J ·霍普菲尔德 (John J. Hopfield)及加拿大科学家杰弗里·E ·欣顿 (Geoffrey E. Hinton)获奖,以表彰他们“基于人工神经网络实现机器学习的基础性发现和发明”。

约翰·霍普菲尔德生于1933年,美国国家科学院及美国艺术与科学院院士,普林斯顿大学教授。他在 1982 年发明了著名的霍普菲尔德神经网络(Hopfield neural network),这是第一个能够储存多种模式,并具备记忆功能的神经网络模型,是神经网络发展早期的一座重要的里程碑。霍普菲尔德神经网络的诞生为递归神经网络的发展铺平了道路,其提出的能量最小化原理,对于解决优化问题产生了深远影响。霍普菲尔德是2006年美国物理学会主席,他于1969年获颁奥利弗·E·巴克利凝聚态物理学奖,1985年获美国成就学院的金盘奖,2001年获国际理论物理中心狄拉克奖章, 2005年获阿尔伯特·爱因斯坦世界科学奖,2022年获玻尔兹曼统计物理学奖。他的著名博士生包括David J. C. MacKay院士(原英国能源与气候变化部首席科学顾问), Terry Sejnowski (美国四院院士,NSF总统青年研究奖得主), Bertrand Halperin院士, Steven Girvin 院士, Erik Winfree (2000麦克阿瑟天才奖), David Beratan院士等。

杰弗里·欣顿1947年生,英裔加拿大计算机科学家,2018年图灵奖得主,英国皇家学会和加拿大皇家学会院士及美国国家科学院外籍院士,前“谷歌大脑”负责人,加拿大多伦多大学教授。欣顿是神经网络最早的研究者之一,20 世纪 80 年代为将反向传播算法(backpropagation)引入多层神经网络训练做出了重要贡献, 并发明了“玻尔兹曼机”——一种在霍普菲尔德神经网络的基础上发展而来的随机递归神经网络。2012 年欣顿及两位学生 Alex Krizhevsky、Ilya Sutskever 发明的AlexNet创造了深度神经网络发展的里程碑并激发了大量采用卷积神经网络(CNN)和图形处理器(GPU)加速深度学习的研究。欣顿与 约书亚·本希奥(Yoshua Bengio )和 和杨立昆 (Yann LeCun )并称为“深度学习三巨头”、“AI教父” ,共同获得 2018 年图灵奖。2023 年 5 月在ChatGPT出现半年后欣顿宣布从谷歌辞职以便能够“自由地谈论人工智能的风险”。他对人工智能的恶意滥用、其引发的技术性失业以及人类的生存风险表达了深切的担忧。

虽然神经网络(即通俗所说的人工智能)看似一个数字技术领域,但其成型和发展离不开基础物理学的启发和承载,这也是本次获得诺贝尔物理学奖的原因。尽管计算机不能思考,但机器可以模仿记忆和学习等功能,通过一个个例子进行学习,使其能够处理那些模糊且复杂到无法通过人类的逐步指令来处理的问题,一个典型的例子就是解读图片,并识别其中的物体。

图片来源:芯语

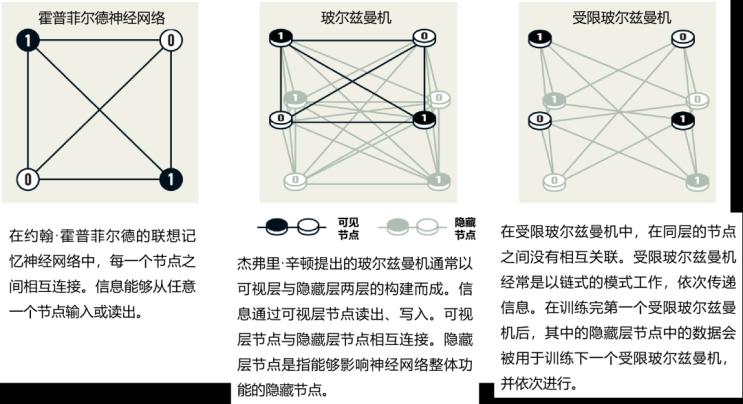

霍普菲尔德于 1982 年发现的联想记忆模型利用分子生物学的神经元原理,使机器能够储存和重现来自案例的模式,并在网络接收到一个不完整或稍有失真的模式时找到与之最相近的已存储模式。欣顿于1985年提出的“玻尔兹曼机”结合统计物理学的思想,通过对组成节点的不断局部更新(但保持网络整体性质不变)实现根据输入的事例而非输入指令进行学习,特别是其为神经网络带来了联想功能以识别未见过的事物。

由于物理学为机器学习的发展提供了工具,因此反过来,观察物理学作为一个研究领域如何从人工神经网络中受益也很有趣。过去的诺贝尔物理学奖所涉及的领域中,已经充满了机器学习的身影,包括使用机器学习来筛选和处理发现希格斯粒子所需的大量数据。其他应用包括减少测量黑洞碰撞产生的引力波的噪声,或寻找系外行星。

近年来,这项技术也开始应用在计算并预测分子和材料的性质——例如计算决定蛋白质分子功能的结构,或者找出哪种新材料可能具有最佳性能,以用于更高效的太阳能电池。